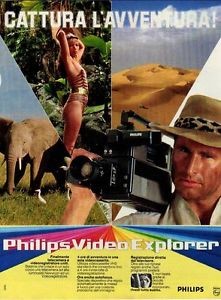

Cattura l’avventura!

Da tempo le macchine sono sempre più sensibili, per riprendere con la luce di una candela… sapete quando ho sentito questa frase?

Da tempo le macchine sono sempre più sensibili, per riprendere con la luce di una candela… sapete quando ho sentito questa frase?

1988 pubblicità di una delle prime spallari VHS della Philips… giusto quei trentanni fà…

Certo erano immagini con un gain (un guadagno artificiale) che neanche sui primi cellulari si vedeva… eppure per l’epoca era magia.

Oggi poi ci troviamo in una serie di situazioni contraddittorie che molti non si spiegano, macchine fotografiche ultra sensibili come le recenti Sony Alpha che spaziano oltre i 200.000 iso (parliamo di duecentomila) fornendo immagini più che decenti se presente un minimo di luce, mentre camere più professionali arrivano a 800-1600 asa le bmc, 3200 asa le Arriflex e le Red, cosa che la maggior parte delle persone non si spiegano.

Le domande che sorgono spontaneamente sono :

– perchè non lo fanno le aziende così blasonate se Sony lo fa ?

– serve veramente avere questa luminosità oltre l’umano?

Sinceramente alla prima domanda non so darmi una risposta, o meglio, posso solo fare ipotesi, relative al tipo di tecnologia che sta dietro alle cineprese, e perchè non si sente la necessità di arrivare a sensibilità così folli, dato che anche con la pellicola nel cinema ci si ferma con la 500 Asa prodotta da Kodak.

A cosa serve una maggior sensibilità di pellicola o sensore?

Il discorso potrebbe essere molto articolato, con tanti discorsi nostalgici, ma mi piace essere pratico.

Il cinema si fa con la luce, quindi a me dei discorsi di riprese in lowlight senza luci o altro non mi frega molto, soprattutto perchè raramente vengono bene anche con i sensori ultrasensibili, mancano i riflessi di luce nei punti giusti, i giochi di luce e ombra, tante cose che sembrano naturali, ma che sono finemente costruiti dai direttori di fotografia.

Un sensore più sensibile aiuta a lavorare meglio in determinate situazioni, punto …

Sfatiamo qualche mito sulla luce naturale ?

- Il recente Revenant con fotografia del premio oscar Lubensky è stato girato in luce naturale, non ha usato luci aggiuntive…

più o meno, ha fatto largo uso di pannelli riflettenti, ha sfruttato fuochi e luci varie naturali, e pare che durante la fase di colorgrading abbiano massaggiato parecchio le immagini per esaltare e amplificare molto i contrasti di luce e le varie tonalità delle immagini.

Comunque, essendo un amante della Golden hour, quell’intervallo di tempo al tramonto in cui c’è una luce magica, so che si può ottenere un risultato molto vicino a quello, ma se lo poteva permettere solo Inarritu, perchè quell’intervallo dura pochi minuti… per sfruttarlo al meglio sono andati più al nord possibile per poter trovare i luoghi con una durata maggiore della Golden Hour. - Se ho luce, quella basta, perchè aggiungere luce?

spesso il problema non è la quantità di luce, ma la distribuzione tra zone di luce e ombra, la direzione, che se sbagliata rovina il viso di attori e attrici, il rischio è che lo sfondo sia più luminoso del primo piano, quindi si deve schiarire il primo piano per non bruciare lo sfondo, che è brutto da vedersi - Se il sensore è sensibile perchè devo usare la luce?

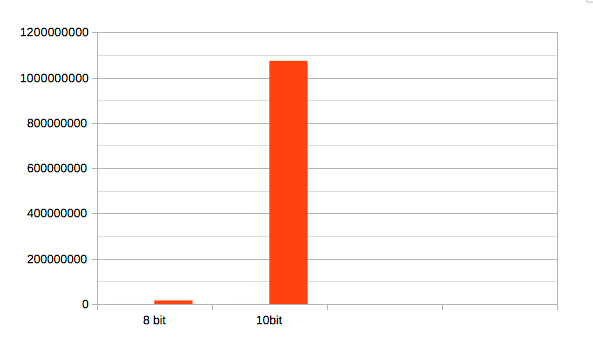

il sensore può essere sensibile ma non a tutta la luce, ma solo a determinate frequenze, per cui più andiamo sul low light, più si perdono alcune frequenze di colore della luce, quindi anche se il sensore è più sensibile è probabile che i colori che può catturare siano meno intensi, o peggio, che ne perda alcuni, il che significa che le immagini saranno più povere e soprattutto limitate - Perchè si usano pellicole meno sensibili al cinema, perchè si devono usare meno iso in ripresa se ci sono?

per una questione di qualità dell’immagine finale, all’alzarsi della sensibilità chimica o elettronica, l’immagine peggiora aumentando il contrasto, riducendo i dettagli fini catturabili, quindi si usa sempre gli ISO o Asa nativi di un sensore o una pellicola e non si “tirano” amplificano in nessun modo. Nella pellicola per catturare maggior luce i grani devono essere più grandi e con una capacità di cambio alla esposizione più duro, quindi diventano velocemente più visibili, offrendo però un contrasto maggiore, e la cattura della luce diventa più grossolana.

Allo stesso modo nel digitale si amplificano le informazioni, ma se queste sono poche, quando si amplificano aumenta il contrasto e quindi si evidenzia l’immagine ma anche il rumore stesso.

Update 2020 : mi fa piacere notare come certi argomenti da me trattati vengano ripresi anni dopo dal noto BlogTecnico RedSharkNews