Storia dei software di editing

Fin dalla preistoria dei programmi di montaggio c’è sempre stato il problema di gestire il flusso video, in primis per questioni di performance, perché i dati di una pellicola non erano gestibili in tempo reale dai computer degli anni 80, e quindi si lavorava con il concetto dell’Offline, ovvero si creava una copia in bassa qualità del girato, si montava la bassa qualità, poi veniva generata una lista di tagli, e una persona dedicata tagliava e rimontava la pellicola alla vecchia maniera, in moviola con scotch e taglierina. Nel caso del video lo stesso discorso avveniva esportando una EDL (edit decision List) compatibile con le centraline dell’epoca e il video veniva nuovamente montato da zero ripartendo dai nastri.

I primi sistemi di montaggio software utilizzavano il nastro come sistema di archiviazione dati, poi negli anni 80 apparve una evoluzione chiamata EditDroid, fatta creare da un tizio barbuto per montare le sue produzioncine, dato che non era soddisfatto della bassa qualità dell’offline su nastro, Edit Droid era un sistema che utilizzava il Laserdisk come supporto, per cui il computer in realtime leggeva e saltava da un laserdisk all’altro (c’erano più lettori in linea) in modo rapido e con una buona qualità rispetto al nastro, con la soddisfazione del personaggio in questione e il suo amico che girava sempre con il cappello da baseball calcato sulla testa, i due strani personaggi che insistevano tanto sulla qualità e sul portare il montaggio ad un livello maggiore erano Lucas e Spielberg, che erano sicuri della rivoluzione in corso.

Negli anni 90 nacque Avid, il primo sistema di massa per il montaggio Offline, dove anche se si montava materiale in bassa qualità, una finestra da 320*200 pixel, con una compressione molto alta, era un modo rivoluzionario rispetto ai precedenti sistemi perché non richiedeva tutto lo spazio per i lettori dei laserdisk stile EditDroid, aveva una compressione variabile (in un’epoca in cui 120 MEGA di hard disk costavano quanto 5.000 euro di oggi, quindi era fondamentale ottimizzare lo spazio), permetteva di lavorare con strumenti più evoluti rispetto ai precedenti.

Fin dalla sua nascita Avid basò il suo flusso di lavoro su il codec DI Avid, ovvero il materiale originale era convertito in un formato più adatto a lavorare il video, pur mantenendo le informazioni come codici di tempo per il montaggio finale da centraline, codici pellicola per un taglio preciso, strumenti più vicini a quella che era la mentalità dell’epoca di montatori video e cinema.

Con il passare del tempo questo codec di lavorazione si è evoluto fino all’attuale DnxHR che supporta una risoluzione spaziale virtualmente infinita, e può essere codificato in qualità 4:4:4 per essere non solo un codec off-line a codec on-line.

Facciamo un salto in avanti di qualche anno, nascono diversi software di montaggio video e ogni marchio svilupperà il proprio codec di lavoro, che nel tempo si sono evoluti, da codec offline, quindi di bassa qualità, ma alta compressione al principio opposto ovvero un codec DI, Digital Intermediate.

Cos’è il codec DI?

Un codec DI, Digital intermediate è un codec di lavorazione che nasce per essere il modo migliore di gestire il materiale audio video che abbiamo realizzato, un Di nasce per essere :

- un codec di altissima qualità e livello visivo

- leggero da usare, leggere e scrivere su qualunque programma

- supportare profondità colore anche maggiore del file di partenza per agevolare la correzione colore e preservare ogni tipo di informazione.

- permettere ricompressioni (generazioni multiple) senza perdite apparenti

Anche se la maggior parte dei programmi di montaggio moderni prevedono la possibilità di usare i file nativi, in molte situazioni è molto più efficiente come velocità e qualità convertire i file in un codec DI per gestire meglio il materiale video.

Perchè usare un codec DI

per quanto il nostro sistema di editing sia potente, veloce, ottimizzato, arriveremo sempre al suo limite, o per quantità di tracce, effetti, o per filmati a crescente risoluzione e profondità colore (4k HDR), quindi è importante sapere che possiamo ottimizzare le capacità e potenzialità dei nostri computer sfruttando questo tipo di codec alternativo ai codec originali.

Una buona ragione per usare un codec DI?

- possibilità di editare e riprodurre correttamente video pesanti che la macchina non sarebbe in grado neanche di riprodurre

- possibilità di editare e manipolare in modo più rapido il video

- esportare in un formato non a perdita, ma che conservi la qualità originale senza occupare tutto lo spazio del non compresso

- poter usare un codec che non venga INTERPRETATO ma letto direttamente per evitare le strane problematiche che possono nascere con codec h264/5, Mpg di vario tipo etc etc

- usare un codec universalmente riconosciuto da ogni programma che acceda ai codec di sistema sui due principali sistemi operativi (MacOsX e Windows), senza doversi legare ad un programma o a un sistema, che in passato ha creato problematiche e incompatibilità di vario genere.

I miti sui DI

- Ma se converto in perdo qualità….

la perdita di qualità è relativa alla conversione in formati a perdita, non con i DI che nascono esattamente per preservare e mantenere la qualità orginale.

La conversione va fatta con software dedicati, mentre spesso la perdita di qualità si nota nell’uso di utility di dubbie origini e/o per uso amatoriale, che per convertire rapidamente usano scorciatoie di vario tipo per accelerare le lavorazioni e quindi scartano informazioni secondo loro non utili. - Ma se converto con il codec DI xxx è più pesante…

verissimo per il peso sul disco, al contrario sulla CPU, perchè un codec DI converte i frame da GOP (group of picture) in frame completi, per cui occuperà un maggior spazio sul disco, ma il processore sarà sollevato dai compiti di estrazione dei singoli frame ogni volta che si farà play, avanti, indietro, etc e quindi potrà dedicare i processi alla elaborazione e non alla semplice estrazione dei frame. - Perdo tempo a convertire invece che usare direttamente…

questo è il mito più ridicolo… le persone spesso vedono come tempo perso il tempo di copia e conversione in DI, ma non si accorgono di tutti i rallentamenti che avvengono quando si deve attendere le preview, il calcolo degli effetti, i tempi di analisi durante il montaggio. Usare un DI accelera tutti i processi di rendering e analisi, quindi il tempo di conversione si fa una volta, tutti i tempi di elaborazione durante il progetto vengono sollevati grazie al codec DI. - Ma se poi non posso più leggere il codec XX su un’altra macchina?

i codec DI nascono per la compatibilità, per cui TUTTI sono installabili GRATIS su ogni macchina windows e MacOsX, e spesso sono già integrati sulle suite dei maggiori prodotti di Editing e Post.

Ad esempio Adobe e Blackmagic Design hanno acquisito i diritti per fornire di serie con i loro prodotti encoder e decoder per leggere senza installazioni aggiuntive Prores, Cineform, Avid dnxHD/HR, e per quanto riguarda BMD anche i codec GrassValley.

Se per una qualunque ragione vogliamo visualizzare i file su una piattaforma che non ha questi software è possibile scaricare i codec free per vedere e codificare TUTTI questi codec sui software che leggono dal sistema le librerie dei codec sia sotto MacOsX che Windows, di recente il famoso player free VLC ha aggiunto tali codec nella lista dei decoder. - Se il mio cliente non può installare codec?

partiamo dal principio che di serie senza codec praticamente si può leggere poco o niente su qualunque sistema operativo, perchè persino l’mpg2 senza un lettore dvd software installato non si può leggere sotto windows perchè non hanno acquistato i diritti, stessa cosa sotto MacOsX che legge i dvd, ma non gli mpeg2 dai software se non ha lui stesso i codec, viene letto giusto l’h264 e poco più.

Comunque il cliente mica deve vedere i file originali, e/o consegnare il master al cliente, il cliente riceverà il prodotto finito, che sarà un file compresso, non un DI.

Se il cliente pretende di avere un master o il girato, dovrà anche avere i mezzi per leggerli correttamente… il concetto che non può installare codec non può riguardare la visione il materiale intermedio, e comunque potrà chiedere al reparto IT di installare i codec relativi dato che nessuno di essi offre problemi di compatibilità o rischi di sicurezza (la bufala del quicktime risale ad una versione di quasi 10 anni fà, del 2008, che Apple chiuse ai tempi, l’ultima release del QT per windows non ha nessun rischio di sicurezza). - Qualcuno mi ha detto che è meglio lavorare con i file nativi

quel qualcuno probabilmente intendeva non comprimere i dati ulteriormente convertendoli in formati a perdita, oppure quando si parla di file raw per la parte del montaggio, ma quando si lavora con quel tipo di dati o si ha un DiT che gestirà il workflow o si saprà bene cosa fare e quindi tutto questo discorso e questa domanda non sarà posta.

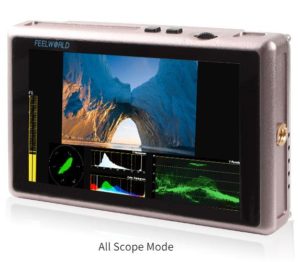

E ci aggiungo quelli che senza usare uno strumento per misurare qualcosa (intensità, temperatura, tinta della luce, contrasto) cambiano temperatura, tinta, contrasto, luminosità del monitor per rendere più naturale e vicina l’immagine del monitor a quella che vedono, sottolineo l’immagine del monitor, non quello che riprende la camera… Questo procedimento genera due errori, perché la realtà ha un colore, la camera ne registra un altro, ma monitor ne vedremo uno simile a quello “reale”, peccato che ci serva a poco, anzi ci porti a credere che la camera registri quei colori, una deviazione della camera nel monitor di uscita e non nella camera….

E ci aggiungo quelli che senza usare uno strumento per misurare qualcosa (intensità, temperatura, tinta della luce, contrasto) cambiano temperatura, tinta, contrasto, luminosità del monitor per rendere più naturale e vicina l’immagine del monitor a quella che vedono, sottolineo l’immagine del monitor, non quello che riprende la camera… Questo procedimento genera due errori, perché la realtà ha un colore, la camera ne registra un altro, ma monitor ne vedremo uno simile a quello “reale”, peccato che ci serva a poco, anzi ci porti a credere che la camera registri quei colori, una deviazione della camera nel monitor di uscita e non nella camera….